最近 MiniMax M2.7 上线之后,其实不少人都在问一个很现实的问题:

这个模型看起来很强,但普通人到底怎么用?

如果你直接去官方平台,体验是有门槛的,要么额度有限,要么需要一定配置。但这两天我在测试的时候,发现一个更简单的入口:

通过 NVIDIA AI 服务可以直接免费使用 MiniMax M2.7,而且不需要绑定银行卡。

这个入口其实很多人还没注意到,但用下来体验还不错,这篇我就把整个流程讲清楚,包括注册、额度、调用方式,以及实际体验感受。

一、为什么推荐用 NVIDIA 来体验 MiniMax M2.7

先说结论,这个入口最大的优势其实不是免费,而是:省事 + 稳定 + 无门槛。

你不需要自己找算力,也不用担心网络问题,整个过程更像是在用一个已经配置好的开发环境。

从实际体验来看,有几个比较明显的点:

首先是注册流程非常简单,只需要邮箱加手机验证即可,不需要绑定信用卡,这一点对很多刚接触 API 的用户来说很友好。

其次是整体调用稳定性不错,毕竟是 NVIDIA 的基础设施,延迟和可用性都比较稳定,不会出现频繁调用失败的情况。

最后是模型接入已经帮你做好了,你不需要自己再去处理复杂的部署或配置,可以直接开始测试。

二、MiniMax M2.7 在这个入口的使用体验

在 NVIDIA 平台里,MiniMax M2.7 的调用方式其实已经被标准化了,本质上就是一个统一 API。

我在实际测试时,主要感受到两个变化:

一是模型在复杂任务中的执行逻辑更清晰,它不会急着给答案,而是更倾向于先组织思路再输出结果。

二是在多轮任务中稳定性更高,尤其是需要连续执行的场景,不容易中途偏离。

这一点其实和它的设计方向有关,它本身就是偏向 Agent 执行模型,而不是单纯聊天模型。

三、如何免费注册并获取使用额度

整个流程其实很简单,但有几个细节需要注意。

1. 注册 NVIDIA AI 服务

入口在这里:

进入之后直接注册账号并登录。

2. 创建 API Key

登录后,创建 API Key 时需要:

选择国家区域

完成手机号验证

这一过程比较快,基本几分钟可以完成。

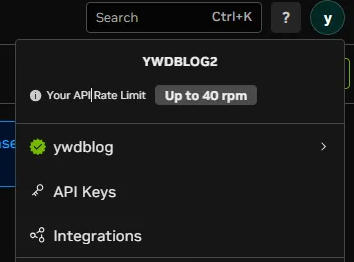

3. 查看免费额度

在个人账户设置中,可以看到当前额度。

我这边测试时的额度是:

👉 每分钟 40 次调用

不过需要注意一点:

这个额度是动态调整的,后续可能会变化。

四、MiniMax M2.7 调用方式(实测可用)

这里直接给你一个可以跑的调用示例。

Shell 调用方式

invoke_url='https://integrate.api.nvidia.com/v1/chat/completions'

authorization_header='Authorization: Bearer <你的Token>'

accept_header='Accept: application/json'

content_type_header='Content-Type: application/json'

data=$'{

"model": "minimaxai/minimax-m2.7",

"messages": [

{

"role": "user",

"content": "写一个自动化脚本"

}

],

"temperature": 1,

"top_p": 0.95,

"max_tokens": 8192,

"stream": true

}'

response=$(curl --silent -i -w "\n%{http_code}" --request POST \

--url "$invoke_url" \

--header "$authorization_header" \

--header "$accept_header" \

--header "$content_type_header" \

--data "$data"

)

echo "$response"

这个接口本质上是统一的 OpenAI 风格调用方式,所以如果你之前用过 GPT API,上手会非常快。

五、MiniMax M2.7 和同类模型对比

为了更直观一点,可以简单看一下当前几个主流模型的定位差异:

| 模型 | 核心定位 | Agent能力 | 工具调用方式 | 适合场景 |

|---|---|---|---|---|

| MiniMax M2.7 | 执行型模型 | 强(多角色协作) | Tool Search | 自动化任务、Agent系统 |

| GPT-5.4 | 通用+执行融合 | 很强 | Tool Search | AI开发、复杂流程 |

| GLM-5 | 推理+Agent | 强 | 优化调用 | 工程任务 |

| Claude 系列 | 对话+推理 | 中等 | 标准调用 | 文本与分析 |

从使用角度来看:

MiniMax 更偏向做事,而不是回答。

六、使用过程中一些真实建议

这一部分我尽量讲一些更接近实际使用的经验。

首先,不要把它当成普通聊天模型来用。如果只是问问题,其实很难发挥它的优势。更合适的方式是给它明确的任务,比如生成项目、执行流程或者自动化脚本。

其次,在复杂任务中,建议分阶段推进,而不是一次性给出完整需求。模型在逐步执行的情况下表现更稳定。

另外,如果你打算长期用这个模型来跑自动化流程,那运行环境会变得很重要。虽然 NVIDIA 这个入口已经足够稳定,但在一些持续运行的项目里,还是建议搭配自己的运行环境来使用。

七、资源入口汇总

NVIDIA AI 服务

👉 https://build.nvidia.com/

MiniMax 官网

👉 https://www.minimax.io

MiniMax 控制台

👉 https://platform.minimax.io

写在最后

如果你只是想体验 MiniMax M2.7,这个 NVIDIA 入口基本是目前最简单的一种方式。

注册就能用,不需要折腾环境,也不用担心网络和算力问题。

但如果你准备进一步做:

AI Agent

自动化流程

长期运行任务

那后面还是会涉及到更稳定的运行环境。

我现在基本会把测试放在这种平台上,而长期运行会放在独立环境里,比如按需付费的服务器(萤光云、LightNode),这样在稳定性和成本之间会更好平衡。